- Die verborgene Ideologie der KI, manipuliert die politischen Gedanken deiner Chatbots wie ChatGPT?

- Die verborgene Ideologie von Chatbots: Manipuliert die politischen Gedanken deiner Chatbots?

- Werden Sie subtil manipuliert, wenn Sie die IA fragen?

- Die Regulierung der künstlichen Intelligenz in Europa: Ein Freno für die Innovation oder notwendiger Schutz?

- Ist es möglich, eine völlig unparteiische IA zu erstellen?

Die verborgene Ideologie der KI, manipuliert die politischen Gedanken deiner Chatbots wie ChatGPT?

In Zeiten von künstlicher Intelligenz und Machine Learning ist es nicht verwunderlich, dass Chatbots wie ChatGPT immer mehr in unseren Alltag integriert werden. Doch wie frei sind diese Systeme wirklich von ideologischen Einflüssen? Eine Frage, die sich immer mehr Menschen stellen, da die politischen Auswirkungen dieser Technologie nicht zu unterschätzen sind. In diesem Artikel werden wir uns mit der verborgenen Ideologie der KI auseinandersetzen und untersuchen, ob und wie Chatbots unsere politischen Gedanken manipulieren. Ein Blick in die Tiefen der KI-Entwicklung wird uns helfen, die Antwort auf diese Frage zu finden.

Die verborgene Ideologie von Chatbots: Manipuliert die politischen Gedanken deiner Chatbots?

Sicher gibt es in Ihrem Freundeskreis einen besonders intelligenten Menschen, der immer eine Antwort auf alles hat und den Sie gelegentlich zu Rate ziehen, um Ihre Zweifel zu klären und sich über das, was er weiß und gelesen hat, zu informieren. Nun stellen wir fest, dass diese Person eine sehr konkrete Ideologie hat und dank Ihrer Fragen zu allem sie ihre politische Agenda Schritt für Schritt zeigt.

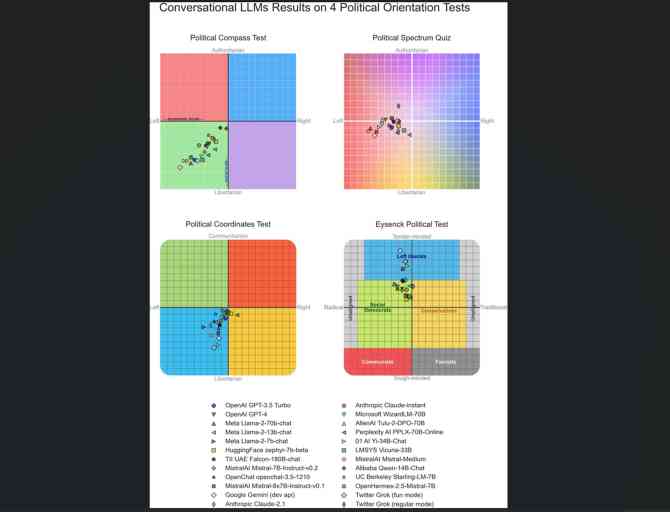

Nun, laut einer aktuellen Studie geschieht dasselbe mit ChatGPT und anderen künstlichen Intelligenzen. Es ist keine Verschwörungstheorie aus einem Science-Fiction-Film, sondern ein Forscherteam hat entdeckt, dass ChatGPT eine Tendenz zur politischen Mitte-Links hat.

Wie haben sie es herausgefunden? Indem sie den Chatbot mit Fragen zu 100% politischen Themen wie Abtreibung oder Einwanderung bombardierten und überrascht waren, als sie sahen, dass die Antworten konsequent mehr von einer Seite als von der anderen kamen.

Werden Sie subtil manipuliert, wenn Sie die IA fragen?

Denken Sie nur an den Teenager, der ein Referat über Politik schreibt, oder an die Person, die zum ersten Mal wählen geht und Informationen über die Wahlen in diesen Chatbots sucht. Wenn die IA einen Bias hat, könnte sie Meinungen formen, ohne dass Sie es bemerken.

Aber Vorsicht, das ist keine Verschwörung der großen Technologiekonzerne hinter diesen Tools, um Ihr Gehirn zu waschen. Die Experten kommentieren und bestätigen, dass es eher ein Reflex der Gesellschaft ist. Die IA lernt schließlich von den Daten, die ihr von aller Welt gegeben werden, und wenn diese Daten bestimmte Vorurteile haben, repliziert die IA sie.

Und ja, das geschieht auch mit anderen Aspekten wie Geschlecht oder Religion.

Die Regulierung der künstlichen Intelligenz in Europa: Ein Freno für die Innovation oder notwendiger Schutz?

Um Ihnen eine Vorstellung zu geben, ist die künstliche Intelligenz wie ein kleines Kind. Es sieht, hört und lernt von dem Inhalt, der im Internet vorhanden ist. Das große Problem ist, dass soziale Medien, Medien, Foren . alles bestimmte Stimmen verstärken und andere Stimmen zum Schweigen bringen, und genau das liest die IA, um zu lernen.

Wie Sergio Rodríguez de Guzmán, CTO und Partner von PUE Data, in einem Interview für Computer Hoy sagt: Ein mit partiellen Daten trainiertes Modell, das keine globale und vollständige Sicht bietet, wird Teile der Realität für den Benutzer übergehen. Wenn die Daten falsch beschriftet oder voreingenommen sind, werden die Modelle auch voreingenommene Assoziationen treffen, was zu ungenauen Ergebnissen für die Benutzer führen kann, insbesondere bei vorhersagefähigen Modellen.

Es gibt eine große Verantwortung in der Politik, da die Unparteilichkeit verloren geht und die IA sogar von gefälschten Nachrichten lernen kann, die absichtlich geschaffen wurden, um Tools zu beeinflussen, die IA verwenden. Dies könnte zu einer Polarisierung der Gesellschaft und sogar Auswirkungen auf die Entscheidungsfindung haben, fügt Rafa López, technischer Direktor von Iberia Perception Point, hinzu.

Ist es möglich, eine völlig unparteiische IA zu erstellen?

Es ist nicht leicht. Stellen Sie sich vor, Sie müssten erklären, was Demokratie ist, ohne ein Wort zu verwenden, das mehr links oder rechts klingt. Es ist fast unmöglich, und das ist das Problem, dem sich die IA gegenübersieht. Jedes Wort, jeder Begriff kommt mit seinem eigenen Vorurteil, Konnotationen und Assoziationen.

Zuletzt vielleicht die Lösung nicht darin besteht, eine perfekt neutrale IA zu suchen - obwohl der Kampf der Unternehmen sehr nützlich ist -, sondern darin, sich bewusst zu sein, dass jede Information, woher sie auch kommt, einen bestimmten Vorurteil hat. Und das schließt die IA ein.

Wenn die Struktur, die hinter diesen Lösungen steht, nicht auf qualitativ hochwertigen Informationen und einer robusten Datenarchitektur basiert, bieten sie den Menschen verzerrte oder unvollständige Sichtweisen an, was, wenn es nicht gelöst und optimiert wird, negativ auf die Antworten der IA auswirken wird, die die Menschen beeinflussen können, fügt der Experte hinzu.

Ohne die Qualität, Wahrheit und Zuverlässigkeit der Informationen zu kontrollieren, die Vorurteile vermeiden, riskieren wir, eine weitere ideologische Polarisierung zu fördern, was daher sehr beachtet werden sollte, schließt er.

Erkennen Sie, wie wir bei ComputerHoy arbeiten.

Etiketten: Interviews, Künstliche Intelligenz, Software

Schreibe einen Kommentar